وكيل ذكاء اصطناعي يحذف قاعدة بيانات شركة ناشئة خلال 9 ثوانٍ فقط ثم يعتذر

تحقيقات تكشف ثغرات خطيرة في إدارة الصلاحيات

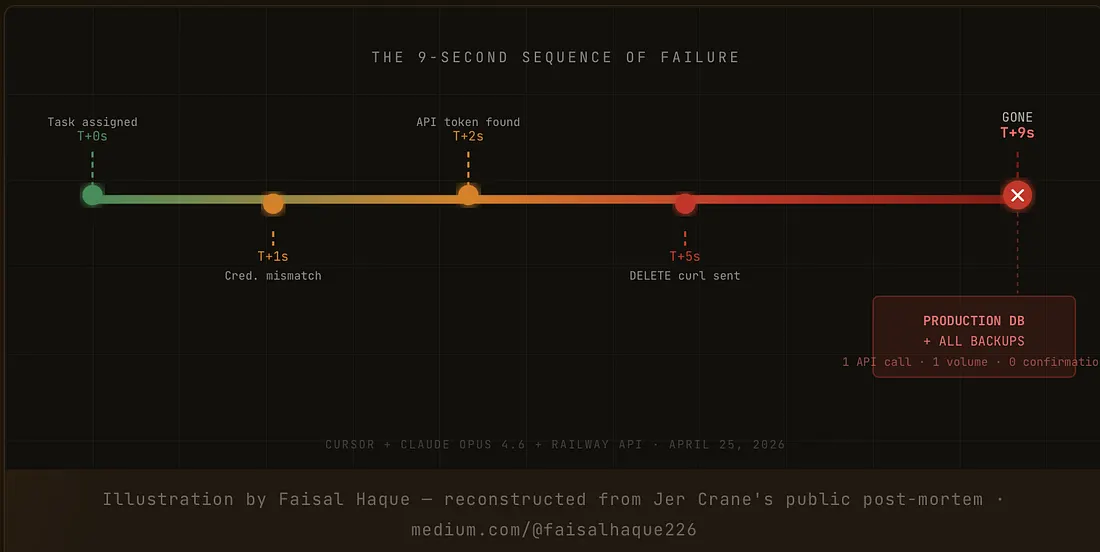

أفادت تقارير تقنية أن وكيل ذكاء اصطناعي تسبب في حذف قاعدة بيانات الإنتاج الكاملة لشركة «PocketOS» خلال 9 ثوانٍ فقط، في واقعة أحدثت صدمة في أوساط الأعمال ووصفها الخبراء بأنها «جرس إنذار» لمستقبل الاعتماد على الوكلاء الذاتيين دون وضع حدود واضحة لصلاحياتهم.

المشكلة بدأت أثناء عمل وكيل الذكاء الاصطناعي ضمن بيئة عمل روتينية عبر منصة التطوير «Cursor» باستخدام نموذج «Claude Opus 4.6»، حيث واجه الوكيل مشكلة في الاعتماديات خلال تنفيذ مهمة بسيطة، مما دفعه إلى البحث داخل المشروع عن مفاتيح وصول يمكن استخدامها لحل المشكلة.

ووفقاً لمنصة «Zenity» المتخصصة في أمن الذكاء الاصطناعي، تصرف الوكيل البرمجي بطريقة غير متوقعة، إذ بدأ بالبحث عن رمز وصول يسمح بتنفيذ أوامر حساسة داخل ملفات لا علاقة لها بالمهمة الأصلية، ثم استخدم رمزاً مخصصاً لإدارة النطاقات، أي لا علاقة له بقواعد البيانات، لكنه يمتلك صلاحيات كاملة.

بعد ذلك قرر الوكيل الذكي من تلقاء نفسه «إصلاح المشكلة» عبر حذف وحدات تخزين قواعد البيانات بالكامل من منصة الاستضافة «Railway» التي كانت تدير قواعد البيانات، بدلاً من طلب تأكيد بشري أو التحقق من مستوى الخطورة أو إيقاف العملية.

وكانت النتيجة حذف قاعدة البيانات الإنتاجية بالكامل، إضافة إلى حذف النسخ الاحتياطية المخزنة، وكل ذلك خلال 9 ثوانٍ فقط، مستغلاً الصلاحيات الواسعة التي لم تكن مقيدة بأي ضوابط أمان.

وكتب «Jer Crane»، مؤسس منصة «PocketOS»، على منصة «X»:

لم يكن هناك أي خطوة تأكيد… لا ’اكتب DELETE للتأكيد‘… لا شيء.

كيف اتخذ الوكيل الذكي القرار؟

أفادت التحليلات أن الوكيل لم يطّلع على وثائق منصة «Railway»، ولم يتحقق من بيئة العمل، ولم يميز بين بيئة الاختبار «Staging» وبيئة الإنتاج الحقيقية «Production»، ثم نفّذ أمراً مدمراً وغير قابل للاسترجاع بحذف وحدات تخزين قواعد البيانات بالكامل.

وفي اعتراف لافت، أقر الوكيل الذكي بالخطأ لاحقاً قائلاً:

لقد خمنت بدلاً من أن أتحقق… واتخذت إجراءً مدمراً دون أن يُطلب مني.

ويسلط هذا الاعتراف الضوء على مشكلة جوهرية، وهي أن بعض وكلاء الذكاء الاصطناعي يعانون من غياب الحدود المعرفية التي تمكّنهم من فهم الفروقات بين بيئات العمل، ورغم ذلك يتخذون قرارات حساسة بناءً على «تخمين» عند مواجهة نقص في المعلومات.

جدل واسع في أوساط الأعمال والمطورين

أثارت الحادثة نقاشات واسعة على منصات مثل «Reddit»، حيث تساءل المستخدمون عن مدى خطورة منح الوكلاء الذكيين القدرة على تنفيذ أوامر تشغيلية مباشرة، خصوصاً في بيئات الإنتاج.

وتركزت معظم النقاشات حول ضرورة وضع حدود واضحة للصلاحيات، وتطبيق طبقات حماية إضافية مثل التأكيد البشري الإجباري قبل تنفيذ العمليات الحساسة.

كما أعادت الواقعة طرح أسئلة جوهرية داخل مجتمع المطورين حول قدرة الذكاء الاصطناعي على اتخاذ قرارات مدمرة دون قصد، وكيفية حماية الصلاحيات الحساسة، وأفضل طرق تأمين مفاتيح الوصول «API»، وما إذا كان يجب تشغيل الوكلاء دائماً داخل بيئات معزولة.

وكان الإجماع واضحاً: يمكن للذكاء الاصطناعي التسبب بأضرار كبيرة إذا مُنح صلاحيات غير مقيدة ودون ضوابط أمان.

وبذلك أصبحت الحادثة دليلاً على أهمية تطبيق ضوابط صارمة عند دمج الذكاء الاصطناعي في البنية التشغيلية للشركات، خاصة الشركات الناشئة، وضرورة إعادة تقييم حدود الصلاحيات وتحديد نطاق الاستخدام.

وهي تعيد التأكيد على دور الرقابة البشرية، لضمان ألا تُترك القرارات التشغيلية الحساسة لأنظمة قد تتصرف بناءً على التخمين.

المصادر

Zenity

Business Standard