كيف تكشف التزييف العميق للصور ومقاطع الفيديو في 2026؟

7 نصائح عملية لمواجهة التزييف والمحتوى المشبوه

يعد التمييز بين المحتوى الحقيقي والمولد بالذكاء الاصطناعي، من المهام الصعبة في عصرنا الحالي، خاصة الصور ومقاطع الفيديو، نتيجة التطوير المستمر للتقنيات المستخدمة في إنشائها، وانتشارها السريع في أوساط المستخدمين مع اتساع استخدامهم لمنصات التواصل الاجتماعي.

وتبرز أهمية التمييز نتيجة ما سُجِّل من استخدام سلبي للتقنية في توليد صور وفيديوهات مزيفة بالذكاء الاصطناعي فيما بات يعرف بالتزييف العميق (Deepfake)، لاستخدامها في نشر محتوى مضلل ضمن سياقات متنوعة.

وتشير بيانات لمنصة (Statista) إلى تحول هذه التقنية من مجرد تسلية إلى تهديد أمني ومالي عالمي، إذ إن محتوى الفيديو المزيف يتضاعف تقريباً كل 6 أشهر.

وتوقعت المنصة أن يقفز عدد ملفات التزييف العميق عبر الإنترنت من حوالي 500 ألف ملف في عام 2023 إلى 8 ملايين ملف بنهاية 2025.

وأشارت إلى تصاعد الحوادث المرتبطة بهذه التقنية، حيث ارتفعت من حوالي 50 حادثة شهرياً في 2020، إلى قرابة 500 حادثة شهرياً في يناير 2026، مع نمو لمحاولات الاحتيال عبر التزييف العميق بنسبة 1.7% في أمريكا الشمالية، و1.5% في منطقة آسيا والمحيط الهادئ.

من جهتها، تتوقع شركة (Deloitte) أن الذكاء الاصطناعي التوليدي قد يرفع خسائر الاحتيال في الولايات المتحدة من 12.3 مليار دولار في 2023 إلى 40 مليار دولار بحلول عام 2027، أي بمعدل سنوي قدره 32%.

لذلك، يصبح من الضروري معرفة آليات عمل نماذج الذكاء الاصطناعي التوليدي، وكيفية التحقق من المحتوى الرقمي وكشف الصور والفيديوهات المزيفة، للحد من مخاطر الوقوع ضحية لمثل هذه التقنيات أو التعرض للتضليل.

كيف يتم توليد الصور والفيديوهات بالذكاء الاصطناعي؟

يتم توليد الصور والفيديوهات عبر نماذج ذكاء اصطناعي تغذيها الشركات باستمرار بمليارات الصور والنصوص لتدريبها على الأنماط.

وتبدأ العملية ببساطة من أمر (Prompt)، يصف فيه المستخدم المحتوى المراد الحصول عليه باللغة العادية، كما يمكن البدء من صورة ثابتة مرفقة مع وصف النصي لإضفاء التأثيرات والحركة تلقائياً.

واليوم أصبحت النماذج أكثر تطوراً، فهي تتيح إمكانية التعديل عبر التفاعل اللحظي مع النموذج ضمن المحادثة، أو التدخل في أي وقت لإجراء تعديلات فورية، وأحياناً تكون التعديلات يدوية للحصول على دقة إضافية، وتقريب المنتج النهائي أكثر إلى الفكرة الأصلية أو الواقع.

وتبرز قدرات نماذج الذكاء الاصطناعي في صناعة الفيديوهات بما تتيحه من أدوات للتحريك، وإضافة حركة كاميرا، مع إمكانية تحسين الإضاءة وتغيير الخلفيات أو حتى إزالة عناصر من الفيديوهات.

ما هي أشهر أدوات توليد الصور والفيديوهات؟

توجد العديد من النماذج والأدوات التي تستخدم لإنشاء صور ومقاطع فيديو واقعية بجودة عالية، مثل (Midjourney) الرائدة في إنتاج صور فنية واقعية فائقة التفاصيل، و(Leonardo.AI) التي توفر نماذج متعددة للصور الواقعية مع إمكانية تعديل متقدمة، و(Veo 3.1) الذي يتيح إنتاج مقاطع فيديو مع صوت، إضافة إلى (Kling) المزود بميزة التحكم الدقيق في حركة العناصر داخل الفيديو، و(Runway Gen-4) الذي يتيح تحكماً دقيقاً بزوايا التصوير وحركة الكاميرا.

لكن معظم هذه الأدوات واجهت ضغوطاً واتهامات بانتهاك حقوق النشر؛ مثل (Kling) التي جُمِّد طرحها عالمياً لفترة قبل دمجها بهدوء في بعض المنتجات، و(Sora) التي اضطرت شركة (OpenAI) إلى إغلاقها تماماً.

ما هو التزييف العميق ولماذا أصبح خطيراً؟

تعد فكرة التزييف العميق امتداداً لتقنيات التلاعب بالصور التي بدأت في القرن التاسع عشر، وتطورت على مدار القرن العشرين في عالم السينما، ثم وجدت طريقها إلى الهواة في المجتمعات الرقمية، لتتحول بعدها إلى مورد غني للشركات للابتكار وإدرار الأرباح.

وتشير التوقعات إلى نمو سوق الذكاء الاصطناعي التوليدي بنسبة 560% بين عامي 2025 و2031 ليصل إلى 442 مليار دولار.

وظهر مصطلح التزييف العميق في نهاية عام 2017 من قبل أحدِ مستخدمي منصة (Reddit) والذي سمّى نفسه (Deepfakes)، عندما نشر إلى جانب آخرين فيديوهات متقنة نسبياً تتضمن محتوى مُسيء مزيّفاً لمشاهير السينما، ما استدعى حراكاً مضاداً للتحذير من استخدام هذه التقنيات في الترويج للأخبار الكاذبة أو المزيفة.

لاحقاً، حظرت منصة (Reddit) المستخدم المذكور عام 2018، وعلى خطاها بدأت المنصات الأخرى بتعديل سياسات الاستخدام لحظر كل من يروج لهذه التقنية.

لكن في الواقع استخدمت تقنيات التزييف العميق بشكل واسع فيما بعد، وكانت “بطلاً” لحملات الانتقام وتشويه السمعة وفبركة الأخبار وهجمات التصيد الاحتيالي، والاختطاف.

ومن الحوادث الشهيرة المسجلة، عملية احتيال عبر الهاتف تعرض لها رئيس تنفيذي لشركة طاقة مقرها بريطانيا عام 2019، حين طُلب منه تحويل مبلغ قدره 220 ألف يورو إلى حساب مصرفي في هنغاريا من قبل شخص استخدم تقنية التزييف العميق الصوتي لانتحال صوت الرئيس التنفيذي للشركة الأم.

واستثمرت التقنية صور مشاهير في عالم السينما والإعلام والسياسة بهدف التأثير على الرأي العام، وحشد التأييد، ومحاربة الخصوم ضمن الحملات الانتخابية.

وشهدت الحملة الرئاسية الأمريكية عام 2020 انتشاراً واسعاً لمقاطع فيديو مزيفة أظهرت الرئيس جو بايدن وهو ينام أثناء المقابلات، أو يضل طريقه، أو يخطئ في التعبير عن أفكاره، الأمر الذي ساهم في تعزيز الشائعات المتعلقة بتدهور حالته الصحية، كما استخدمت الحملة الانتخابية للمرشح رون دي سانتيس تقنية التزييف العميق عام 2023 لتحريف صورة دونالد ترامب.

بينما في الهند، استخدمت هذه التقنية من قِبل مرشحين سياسيين لترجمة خطاباتهم السياسية إلى لغات إقليمية متعددة، مما أتاح لهم التواصل بفاعلية مع مختلف المجتمعات اللغوية المنتشرة في أرجاء البلاد.

وهكذا تحولت التقنية إلى أداة متقلبة وفقاً لغايات مستخدميها، وباتت تشكل تهديداً معرفياً للمجتمعات بما تنشره من تضليل، إضافة إلى أنها باتت تنذر بمخاطر عديدة كونها تستخدم في تأجيج الخلافات وإثارة خطابات الكراهية.

وما يزيد في خطورة تقنيات التزييف العميق أنها أصبحت بمتناول الجميع، فهي أداة سهلة الاستخدام لا تتطلب خبرة تقنية متخصصة، وتختصر ساعات العمل الطويلة إلى دقائق، وأحياناً ثوانٍ، للحصول على نسخ رقمية من الشخصيات المستهدفة والضحايا.

كيف تميز الصور والفيديوهات المزيفة؟

في خضم هذه التطورات، وبهدف نشر الوعي، خلص خبراء كشف التزييف إلى مجموعة من الإجراءات التي تساعد على كشف زيف المحتوى المرئي المولد بالذكاء الاصطناعي، سواء أكان صوراً أم فيديوهات، وهي مزيج من تقنية الملاحظة بالعين البشرية، والتقنيات الحديثة باستخدام أدوات متخصصة.

المهارات البشرية لكشف التزييف العميق:

رغم التطور الذي وصلت إليه تقنيات الذكاء الاصطناعي التوليدي، لا يزال ممكناً تمييز الصور والفيديوهات الحقيقية من المزيفة، من خلال ملاحظة بعض العلامات ضمن المحتوى، مثل:

- التناسق المفرط في المشهد العام: في المحتوى المولد بالذكاء الاصطناعي يكون ترتيب عناصر الصورة “مثالياً” بشكل غير واقعي.

– الإضاءة والظلال: تتضمن الصور والفيديوهات المزيفة إضاءة لا مصدر لها، إضافة إلى تغيرات غير منطقية في الإضاءة والظلال.

– انعكاسات الضوء: إحدى العلامات المهمة التي يجب التأكد منها هي انعكاس الضوء على النظارات أو العيون، ففي التزييف العميق غالباً ما يفشل الذكاء الاصطناعي في تمثيل فيزياء الضوء الطبيعية عند حركة الرأس.

– خلفيات غير منطقية ضمن المشهد: قد يتضمن المحتوى لافتات ونصوصاً مشوهة وغير مقروءة في الخلفية.

- تكرار الأنماط: قد يتضمن المحتوى المولد بالذكاء الاصطناعي نسخاً متطابقة للوجوه، أو الأشجار، أو قطع الملابس ضمن المشهد الواحد دون مبرر.

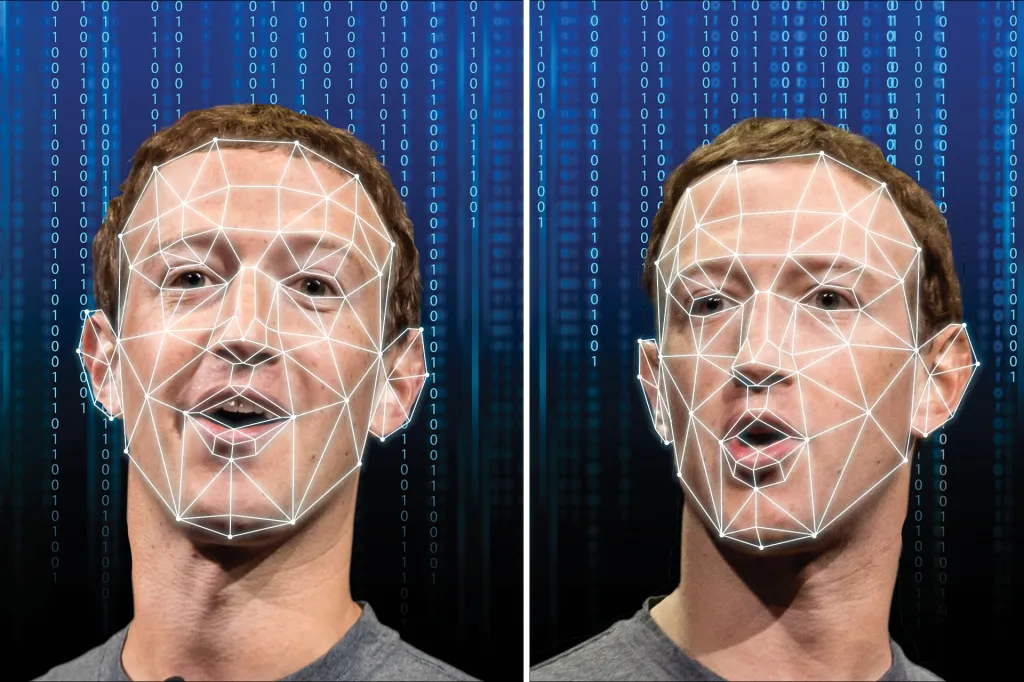

– تفاصيل وجه الشخصيات: غالباً ما تبدو البشرة في التزييف العميق “مصقولة” بشكل مبالغ فيه وتفتقر إلى المسام الطبيعية، أو قد تظهر شامات وتجاعيد لا تتناسب مع شكل الوجه.

– حدود غير طبيعية حول الوجه: تظهر أحياناً آثار ضبابية في المناطق التي يلتقي فيها الوجه المزيف مع الشعر أو الرقبة.

– الشعر والأسنان: يميل الشعر في الفيديو المزيف إلى التحرك ككتلة واحدة بدلاً من التحرك الحر كخصلات منفردة، وتظهر الأسنان غالباً ككتلة بيضاء واحدة دون فواصل واضحة.

– عيوب العينين والرؤية الجانبية: قد تظهر العيون بزوايا غير طبيعية، أو اتجاهات نظر غريبة، أو بحركة رموش نادرة.

كما تظهر تشوهات واضحة عندما يدير الشخص رأسه جانباً بشكل كامل، لأن معظم النماذج التوليدية تتدرب على صور الوجه الأمامية.

– عيوب الأطراف: غالباً ما يواجه الذكاء الاصطناعي صعوبة في محاكاة الأطراف البشرية، فتظهر الشخصية بثلاثة أيدي أحياناً، والأيدي تكون مشوهة بأصابع زائدة، أو ناقصة، أو ملتحمة ببعضها.

– الصوت: علاوة على عدم تطابق حركة الشفاه مع الصوت، يجدر ملاحظة أنماط التنفس ومواقعها أثناء التحدث، وكذلك نبرة الصوت، فالأصوات المستنسخة قد تبدو رتيبة وتفتقر إلى التقلبات العاطفية الطبيعية التي تناسب سياق الحديث.

– الحواف والملابس: تبدو حواف الأشياء أو الملابس في الصور والمقاطع المولدة بالذكاء الاصطناعي غير محددة بوضوح ومندمجة تقريباً مع الخلفية ضمن طبقة واحدة.

الأدوات المتخصصة في كشف التزييف العميق (Deepfake Detection):

في حال تعذر الكشف البشري، تتوفر العديد من الأدوات لكشف الصور والفيديوهات المزيفة بشكل فردي أو تعاوني، أهمها:

- (Microsoft Video Authenticator): أداة طورتها مايكروسوفت لتحليل الفيديوهات والصور لإعطاء نسبة مئوية لاحتمالية أن يكون المحتوى تزييفاً عميقاً عبر رصد الحواف الباهتة التي لا تراها العين البشرية.

- (Deepware Scanner): منصة متخصصة تتيح رفع الفيديوهات أو وضع روابطها لفحصها عبر عدة نماذج ذكاء اصطناعي لكشف التلاعب بالوجوه.

- (Intel FakeCatcher): تقنية متطورة من شركة إنتل تعتمد على “رصد تدفق الدم” في الوجه، حيث تبحث عن التغيرات الطفيفة في لون الجلد الناتجة عن نبضات القلب، وهو أمر لا تستطيع معظم خوارزميات التزييف محاكاته بدقة حتى الآن.

- (Sensity AI): منصة احترافية تستخدمها المؤسسات لرصد التزييف العميق وحماية الهوية البصرية، وتوفر تقارير تقنية مفصلة حول الفيديو المشبوه.

- منصات التحقق الجماعي، مثل:

(Reality Check) و(FactCheck.org): لا توفر أدوات تقنية مباشرة، لكنها تقدم قواعد بيانات للفيديوهات التي تم إثبات تزييفها بالفعل، مما يوفر عناء الفحص اليدوي.(FotoForensics) و(Forensically): أدوات تركز على تحليل مستوى الخطأ. إذا تم دمج وجه شخص في فيديو، تظهر اختلافات في جودة “البكسلات” والضغط الرقمي في المناطق التي تم التلاعب بها.

أدوات إضافية للبحث العكسي:

يمكن استخدام محركات البحث مثل (Google Reverse Image Search) للتأكد من سياق الصورة والفيديو، أو (YouTube DataViewer)، وهي أداة بسيطة تتيح إدخال رابط فيديو يوتيوب لمعرفة وقت رفعه الأصلي بدقة واستخراج صور منه للبحث.

كما يمكن استخدام الإضافات المتاحة في المتصفح (Chrome)، مثل (InVID) أو (WeVerify)، للتأكد من أن الفيديو رُفع سابقاً بسياق مختلف عما يتم نشره فيه حديثاً.

7 نصائح عملية لمواجهة التزييف والمحتوى المشبوه

يشكل الوعي دوماً خط الدفاع الأول ضد التلاعب الرقمي، ومع ذلك يقدم الخبراء عدداً من التوصيات للتعامل مع الصور المولدة بالذكاء الاصطناعي والمحتوى المشبوه، بعضها مبني على منهجية قدمها معهد (Poynter) تدعى (MediaWise)، لتجنب الوقوع في فخ التضليل، ومن أبرزها:

- التوقف: عندما يثير أي منشور تصادفه مشاعر قوية مثل الغضب أو الإعجاب المبالغ فيه من النظرة الأولى، توقف قبل التفاعل أو المشاركة.

- فحص المحتوى: تفحص الصورة أو الفيديو، وابحث عن العلامات الغريبة وغير المنطقية التي عرضنا بعضها آنفاً، بحثاً عن الأخطاء التقنية والفنية المحتملة.

- التحقق من مصدر المحتوى: ابحث عن المصدر الأصلي للفيديو أو الصورة، هل هو وكالة أنباء موثوقة أم حساب مجهول؟ اسأل “من وراء هذه المعلومة؟”، وابحث عن خلفيته وتاريخه.

- الاعتماد على مصادر موثوقة: لا تصدق خبراً عاجلاً على الفور، تحرى مصادر متعددة (ينصح بثلاثة أو أربعة مصادر إعلامية كبرى ومستقلة).

- قطع سلسلة التضليل: تجنب إعادة نشر أي محتوى، خاصة المرئي، قبل التأكد من صحته، كي لا تتحول إلى حلقة في سلسلة التضليل والتلاعب العاطفي. وفي هذا الصدد، ينصح الخبراء أيضاً بتجنب الوقوع فيما يسمى بـ(التزييف الضحل) عبر إعادة نشر فيديو قديم على أنه جديد، مما يعني التلاعب بالسياق.

- التبليغ: عند اكتشاف محتوى مضلل أو مزيف، بلّغ عنه فوراً على منصات التواصل الاجتماعي.

- حماية الخصوصية الرقمية: يُنصح بتقليل البصمة الرقمية، والانتقائية فيما تنشره علناً من صور ومقاطع فيديو شخصية واضحة للوجه لمنع استخدام صورك في عمليات تزييف ضدك.. وفعّل المصادقة الثنائية (MFA) لحماية حساباتك من الاختراق واستخدام هويتك في نشر التضليل.

المصادر

(Wikipedia)

(MIT Media Lab)

(Poynter)

(Sanction Scanner)

(UNESCO)

(Statista)